CISA-Chef unter Druck nach ChatGPT-Datenleck

29.01.2026 - 05:01:12 | boerse-global.deDie US-Cybersicherheitsbehörde CISA ermittelt gegen ihren eigenen kommissarischen Direktor. Madhu Gottumukkala soll sensible Regierungsdokumente in die öffentliche Version des KI-Chatbots hochgeladen haben. Der Vorfall wirft grundsätzliche Fragen zum Umgang mit künstlicher Intelligenz in Sicherheitsbehörden auf.

Internes Dokument in öffentlicher KI gelandet

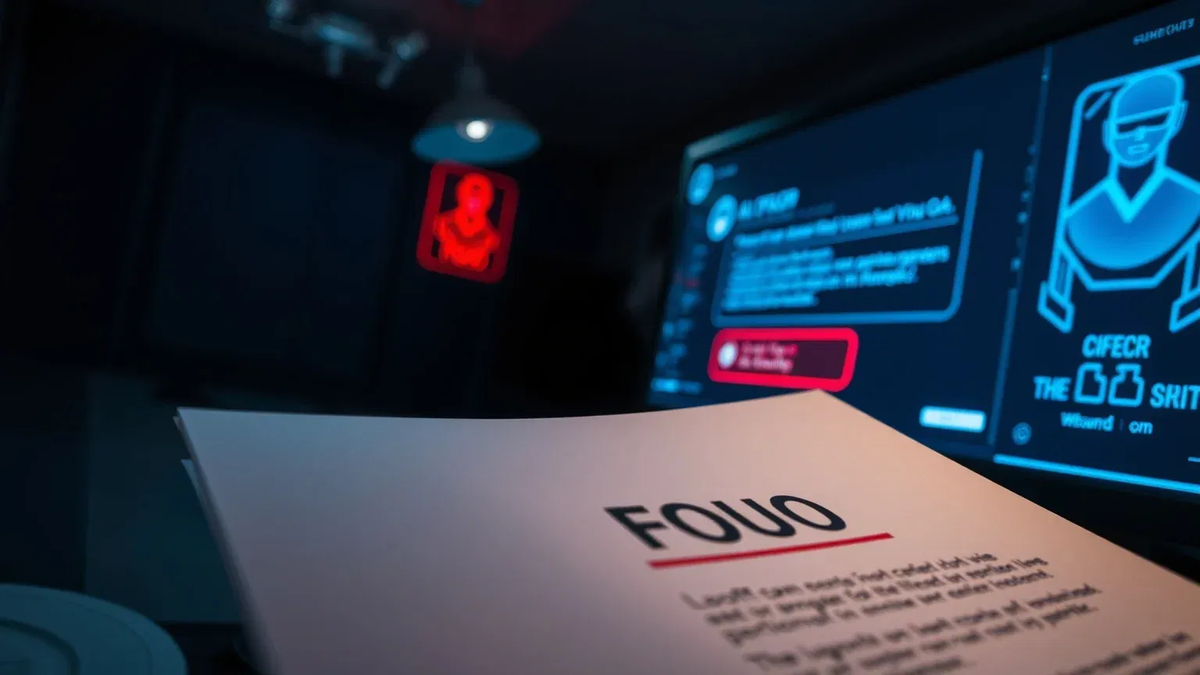

Laut Untersuchungsberichten kopierte der höchste politische Beamte der Cybersecurity and Infrastructure Security Agency (CISA) im Sommer 2025 interne Unterlagen in ChatGPT. Die Dokumente waren zwar nicht als geheim eingestuft, trugen jedoch den Vermerk „For Official Use Only“ (FOUO) – für den internen Dienstgebrauch bestimmt.

Betroffen waren Unterlagen zu Vertragsangelegenheiten und internen Prozessen der Behörde, die für das öffentliche Netzwerk nicht vorgesehen sind. Entdeckt wurde der Datentransfer nicht zufällig: Im August 2025 schlugen die automatischen Sicherheitssysteme der CISA selbst Alarm.

Viele Organisationen unterschätzen, welche rechtlichen und dokumentarischen Pflichten mit dem Einsatz öffentlicher KI-Modelle einhergehen. Die EU-KI-Verordnung verlangt Kennzeichnung, Risikoklassifizierung und ausführliche Dokumentation – Pflichten, die auch Sicherheitsbehörden betreffen. Ein kompakter Umsetzungsleitfaden erklärt präzise, welche Schritte jetzt nötig sind, welche Fristen zu beachten sind und liefert Checklisten zur schnellen Umsetzung. Jetzt kostenlosen KI-Umsetzungsleitfaden herunterladen

Sondergenehmigung für Spitzenbeamten

Besonders brisant: Gottumukkala hatte eine Ausnahmegenehmigung. Während für die meisten Mitarbeiter von CISA und des Heimatschutzministeriums (DHS) der Zugang zu öffentlichen KI-Tools gesperrt war, durfte der Behördenchef ChatGPT nutzen. Diese Sonderregelung stellt nun die internen Kontrollmechanismen in Frage.

Öffentliche KI-Modelle wie ChatGPT speichern und lernen potenziell aus eingegebenen Daten. Sensitive Informationen könnten so unbemerkt in Trainingsdaten einfließen oder anderen Nutzern zugänglich werden. Ein CISA-Sprecher betonte, die Nutzung sei „kurzfristig und begrenzt“ gewesen und unter Aufsicht des DHS erfolgt. Ergebnisse der Schadensanalyse liegen noch nicht vor.

Sicherheitsdilemma: Modernisierung versus Schutz

Der Fall zeigt das grundsätzliche Spannungsfeld, in dem Sicherheitsbehörden weltweit agieren. Einerseits drängt der Wettbewerb zur Nutzung moderner KI-Werkzeuge für mehr Effizienz. Andererseits hinken die Sicherheitsprotokolle dieser rasanten Entwicklung oft hinterher.

Cybersicherheitsexperten warnen seit Langem vor den Risiken öffentlicher KI-Modelle für behördliche Daten. Der Vorfall bei CISA dürfte nun eine grundlegende Überprüfung der KI-Nutzungsrichtlinien in US-Behörden auslösen. Besonders im Fokus: Führungskräfte mit Zugang zu sensiblen Informationen.

Vorwürfe häufen sich gegen CISA-Chef

Die Ermittlungen kommen zu einer ungünstigen Zeit für Gottumukkala. Sein Führungsstil war bereits zuvor in die Kritik geraten. Berichte über einen nicht bestandenen Lügendetektortest und die Suspendierung langjähriger Mitarbeiter von Zugängen zu Verschlusssachen belasten zusätzlich.

Das Heimatschutzministerium muss nun das volle Ausmaß des Datenabflusses bewerten und Konsequenzen ziehen. Die Entscheidung könnte nicht nur über Gottumukkalas Zukunft entscheiden, sondern auch strengere KI-Richtlinien für alle US-Bundesbehörden zur Folge haben.

In einer Zeit, in der ausländische Akteure KI für Cyberangriffe nutzen, unterstreicht der Vorfall eine dringende Notwendigkeit: Behörden müssen sichere, eigene KI-Umgebungen schaffen – bevor die Werkzeuge der Modernisierung zum Sicherheitsrisiko werden.

PS: Behörden, IT-Verantwortliche und Compliance-Teams — sind Sie vorbereitet auf Prüfungen und Bußgelder, wenn KI-Einsätze nicht ausreichend dokumentiert sind? Der kostenlose Leitfaden zur EU‑KI‑Verordnung erklärt verständlich Kennzeichnungs- und Dokumentationspflichten, zeigt die wichtigsten Übergangsfristen und liefert eine sofort einsetzbare Checkliste für Risikoklassifizierung und Nachweisführung. Ideal für Entscheider, die jetzt rechtssicher handeln müssen. Kostenlosen KI-Umsetzungsleitfaden jetzt anfordern

So schätzen die Börsenprofis Aktien ein!

Für. Immer. Kostenlos.