NVIDIAs 800-Volt-Architektur soll KI-Fabriken antreiben

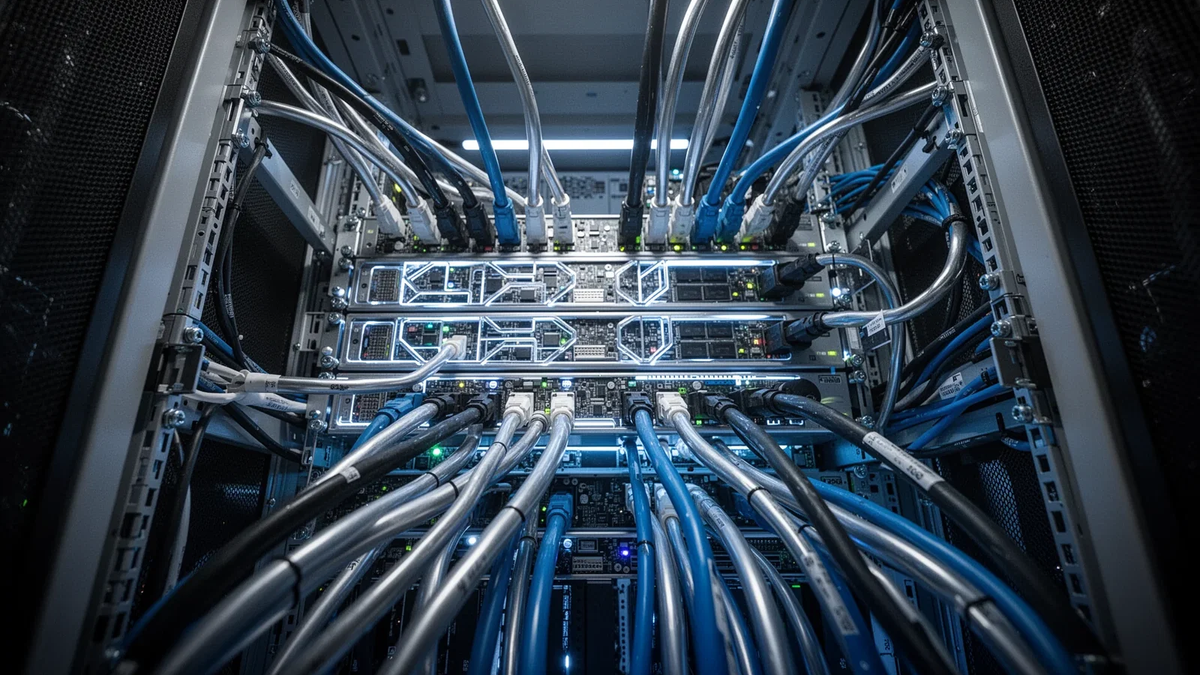

26.03.2026 - 04:40:36 | boerse-global.deNVIDIA setzt mit einer neuen Hochspannungs-Architektur den Standard für die nächste Generation von KI-Rechenzentren. Die 800-Volt-Gleichstrom-Technologie soll die Energieeffizienz revolutionieren und Megawatt-Racks ermöglichen.

Auf der Entwicklerkonferenz GTC 2026 stellte der Grafikchip-Pionier die Architektur als Antwort auf die explodierenden Strombedürfnisse von KI-Workloads vor. Sie verspricht bis zu 5 Prozent höhere Effizienz und reduziert den Materialeinsatz drastisch. Damit adressiert NVIDIA ein zentrales Problem: Herkömmliche Rechenzentren stoßen bei der Versorgung moderner KI-Beschleuniger an ihre physikalischen Grenzen.

Während neue Hardware-Architekturen die Effizienz von Rechenzentren steigern, wachsen mit der Vernetzung auch die digitalen Bedrohungen für Unternehmen. Dieser Experten-Report enthüllt effektive Strategien, wie sich der Mittelstand ohne Budget-Explosion gegen Cyberkriminelle wappnen kann. Effektive Cyber-Security-Strategien entdecken

Der Kampf gegen den Energie-Flaschenhals

Das Herzstück des Problems sind die immer hungrigeren KI-Chips. Aktuelle GPU-Racks nähern sich der Megawatt-Schwelle – eine Leistung, für die die verbreiteten 54-Volt-Systeme nicht ausgelegt sind. Die Folge sind ineffiziente, mehrstufige Spannungswandlungen, hohe Wärmeentwicklung und Platzverschwendung durch dicke Kupferkabel und zahlreiche Netzteile.

NVIDIAs Lösung ist radikal einfach: Statt Wechselstrom aus dem Netz mehrfach umzuwandeln, wird er direkt am Rechenzentrum in 800 Volt Gleichstrom gewandelt. Dieser Hochspannungs-Gleichstrom wird dann bis zum Server-Rack geleitet. Dadurch entfallen viele Zwischenschritte, die Energie in Wärme verwandeln. Weniger Netzteile und Lüfter bedeuten zudem höhere Zuverlässigkeit und einfachere Kühlung.

Mehr Leistung, weniger Kupfer: Die Vorteile im Detail

Die Umstellung lohnt sich gleich mehrfach. Partner wie Texas Instruments präsentierten auf der GTC Wandlermodule mit einem Wirkungsgrad von bis zu 97,6 Prozent. Jede gesparte Wattstunde Strom fließt direkt in die KI-Berechnung und verbessert die Wirtschaftlichkeit, gemessen in „Tokens pro Watt“.

Die Skalierbarkeit ist ein weiterer Trumpf. Die Architektur unterstützt Racks von 100 Kilowatt bis über ein Megawatt – auf derselben Infrastruktur. Das ermöglicht eine höhere Rechen-Dichte und mehr GPUs pro Quadratmeter. Der vielleicht greifbarste Vorteil: Bei höherer Spannung fließt weniger Strom. Dadurch können Kabel dünner ausfallen. Der Kupferbedarf sinkt im Vergleich zu herkömmlichen Systemen um bis zu 45 Prozent. Das spart Kosten und schafft Platz für mehr Rechenleistung.

Neben der physischen Infrastruktur stellt auch die neue KI-Regulierung Unternehmen vor große Herausforderungen. Erfahren Sie in diesem kostenlosen Leitfaden, was Geschäftsführer jetzt über Cyber Security und die aktuelle Gesetzeslage wissen müssen. Kostenloses E-Book zu Cyber-Security-Trends sichern

Ein Ökosystem formiert sich: Die Partner-Innovationen

Der Wechsel zu 800 VDC ist eine gemeinsame Anstrengung der Industrie. Auf der GTC zeigten mehrere Schlüsselpartner konkrete Produkte:

- Flex kündigte ein 800-VDC-Power-Rack für die NVIDIA-Vera-Rubin-Plattform an. Durch eine entkoppelte Architektur soll die verfügbare Rechenleistung pro Rack von etwa 125 kW auf bis zu 880 kW steigen.

- Navitas Semiconductor stellte eine Leiterplatte vor, die 800 Volt direkt auf 6 Volt für die GPU-Kerne wandelt. Die auf Galliumnitrid (GaN) basierende Technologie spart eine Zwischenstufe ein – und damit Kosten, Verluste und wertvollen Platz.

- STMicroelectronics erweiterte sein Portfolio um 12V- und 6V-Architekturen für die gigawatt-skalige Infrastruktur.

Diese Innovationen unterstreichen den schnellen Wandel. Die Architektur ist maßgeschneidert für NVIDIAs kommende Rack-Systeme wie Kyber und Vera Rubin, die mit Flüssigkühlung die Hitze der Hochleistungs-GPUs wie dem GB200 abführen.

KI-Fabriken als Helfer für das Stromnetz

Die Bedeutung der Architektur geht über einzelne Server-Racks hinaus. Sie gilt als Schlüssel für den Aufbau echter „KI-Fabriken“ – hochoptimierter Rechenzentren, die für schwankende KI-Lastsprünge ausgelegt sind. In Zusammenarbeit mit Energieversorgern erforscht NVIDIA, wie diese Fabriken zu intelligenten Netzkomponenten werden könnten.

Die Vision: KI-Fabriken passen ihren Verbrauch autonom an die Netzsituation an, drosseln bei Spitzenlast und entlasten so das Stromnetz. Dies könnte nicht nur die Stabilität erhöhen, sondern auch den Bau neuer Kraftwerke verzögern und die Stromkosten für Verbraucher stabil halten.

Ausblick: Grundstein für nachhaltige KI

Die breite Einführung der 800-VDC-Architektur wird mit der Auslieferung der Kyber-Systeme ab 2027 erwartet. Bis dahin soll die Lieferkette reifen. Es handelt sich nicht um ein einfaches Upgrade, sondern um eine Neugestaltung der Rechenzentrums-Infrastruktur. Durch maximale Leistung pro Watt, geringere Materialkosten und bessere Skalierbarkeit legt NVIDIA mit seinen Partnern das Fundament für eine effizientere und nachhaltigere Ära des KI-Computings.

So schätzen die Börsenprofis Aktien ein!

Für. Immer. Kostenlos.